南科大计算机系6篇论文被CVPR 2023录用

近日,南科大计算机系6篇论文被学术会议CVPR 2023录用,其中1篇论文被选为精彩论文(highlight)(精彩论文占被录用论文10%,投稿论文2.5%)。这6篇论文第一作者均为我系博士生。他们分别是郑锋副教授指导的南方科技大学-伯明翰大学联培博士生耿甜甜、杨金宇、南方科技大学-香港大学联培博士生王腾,张宇副教授指导的南方科技大学-香港科技大学联培博士生苟耘豪,于仕琪副教授指导的南方科技大学-香港大学联培博士生沈川福、2021级自主培养博士生樊超。

CVPR是计算机视觉和模式识别领域的国际顶级学术会议,在中国计算机学会推荐国际期刊和会议中,CVPR为人工智能领域的A类会议,在最新的谷歌学术期刊和会议影响力TOP100榜单中,CVPR位居第四,仅次于Science。

1、Dense-Localizing Audio-Visual Events in Untrimmed Videos: A Large-Scale Benchmark and Baseline

Tiantian Geng, Teng Wang, Jinming Duan, Runmin Cong, Feng Zheng*

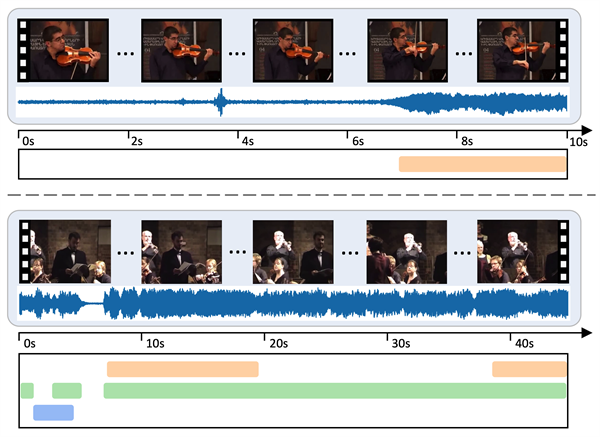

结合多种模态的信息(如视频帧、音频、文本等)对视频内容进行自动理解是当前多模态人工智能领域重要的研究课题之一。传统的视频理解任务包括视频动作识别、视频事件检测、视频描述等,都仅对视频中单一的视觉内容进行理解,忽略了音频信息的重要性。近年来,音视频联合学习的任务被广泛提出,如音视频表征学习、声源视觉定位、音视频事件时序定位等。然而,目前的方法都是基于短视频定义的,每个视频内仅包含一个特定的事件,无法将其应用于复杂的现实场景中。

针对上述问题,我们提出了基于未裁剪视频的密集音视频事件定位任务。该任务的目标是结合视觉与音频信息,在原始的未裁剪长视频中定位所有发生的音视频事件,并识别出相应的事件类别。基于该任务,我们构建了首个基于长视频的大规模音视频数据集(UnAV-100)。该数据集涵盖多个不同的域(人类活动、音乐演奏、自然、动物等),每个视频中包含多个时长不一的音视频事件,且事件之间存在丰富的关联关系。此外,针对该任务,我们构建了基准模型对视频中所有发生的音视频事件进行定位,并同时输出事件的类别。通过大量实验,我们证明了多尺度跨模态感知与事件依赖关系建模对该任务的重要性,且我们的模型与相关方法相比实现了SOTA的性能。

图1

该研究工作的第一作者是郑锋老师指导的2022级南方科技大学-伯明翰大学联培博士生耿甜甜。郑锋老师为通讯作者,南科大为第一单位。

2、Accelerating Vision-Language Pretraining with Free Language Modeling

Teng Wang, Yixiao Ge, Feng Zheng*, Ran Cheng, Ying Shan, Xiaohu Qie, Ping Luo

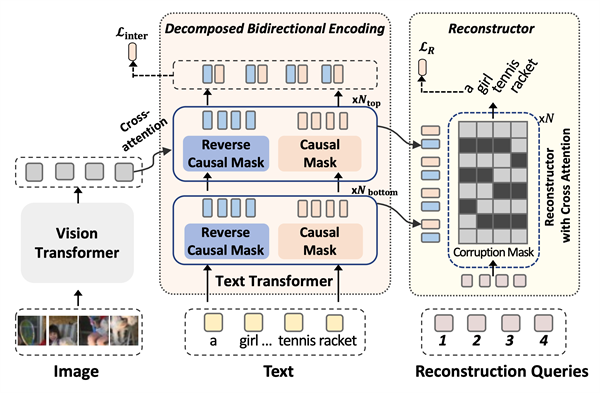

视觉-语言预训练(VLP)利用大规模“图像—文本”对学习跨模态通用表征,可应用于众多下游任务中,如图像问答、图文检索、图像描述等。近年来,主流VLP方法实现了出色的性能,但由于收敛速度慢和训练时间长增大了训练成本,尤其是在大规模网络数据集上。训练效率的一个重要障碍在于掩码语言建模(MLM)中的预测率和损坏率的耦合,即适当的损坏率是以大部分输出令牌被排除在预测损失之外为代价的。为了加速 VLP 的收敛,我们提出了一个新的预训练任务,即自由语言建模 (Free Language Modeling, FLM),它可以在任意损坏率的情况下实现 100% 的预测率。我们成功地将预测率从与损坏率的绑定中解放出来,并允许为每个要预测的令牌定制损坏模式。通过FLM 训练的模型,可以灵活地利用双向上下文,并展示出了更强的样本效率和收敛速度。与基于 MLM 的方法相比,FLM 可以实现预训练时间减少50%,同时在图文理解和生成等四种任务上保持有竞争力的性能。

图2

该研究工作的第一作者是2020级南方科技大学-香港大学联培博士生王腾,导师为郑锋老师。郑锋老师为通讯作者,南科大为第一单位。

3、Resource-Efficient RGBD Aerial Tracking

Jinyu Yang, Shang Gao, Zhe Li, Feng Zheng*, Ales Leonardis

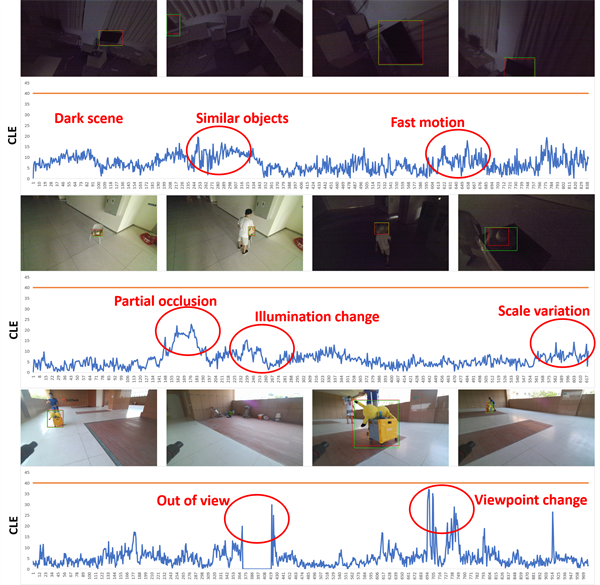

近年来,得益于能够在复杂的环境中飞行的空中机器人,无人机视觉跟踪获得了大量关注。然而,目前对无人机感知的研究主要集中在有限的类别(如行人或车辆)和固定的视角(城市鸟瞰视角)。与此同时,我们发现配备深度相机的无人机也正在被用于复杂的应用中,但RGBD(RGB+深度)的空中跟踪仍有待探索。与传统的RGB目标跟踪相比,添加深度信息可以有效地处理目标和背景干扰等极具挑战性的场景。为此,在本文中,我们深入探索了RGBD空中跟踪,这可以极大地推动基于无人机的视觉感知的发展。为了推动这项研究,我们首先提出了一个RGBD空中跟踪的大规模数据集,并提供了密集的目标标注。其次,由于基于无人机的应用需要在有限的计算资源下进行实时处理,我们还提出了一种高效的RGBD跟踪器EMT(Efficient Multimodal Tracker)。得益于其高效的多模式融合和特征匹配,我们的跟踪器在GPU上运行速度可达100 fps,在NVidia Jetson NX Xavier上运行约25 fps。通过大量实验,我们验证了EMT具有良好的跟踪性能和模型效率。

图3

该工作由南科大视觉智能与感知课题组2019级博士生杨金宇,2021级硕士生高尚,2022级博士生李哲完成,郑锋老师为通讯作者,南科大为第一单位。

4、Leveraging per Image-Token Consistency for Vision-Language Pre-training

Yunhao GOU, Tom Ko, Hansi Yang, James Kwok, Yu Zhang*, Mingxuan Wang

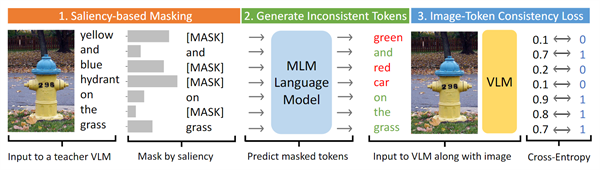

大多数现有的视觉语言预训练(VLP)方法采用跨模态掩码语言建模(CMLM)来学习视觉语言关联。但是,根据我们的观察, CMLM 不足以达到此目的:(1)模态偏见:CMLM 中相当多的掩码标记可以仅通过语言信息恢复,忽略视觉输入。(2)未掩码标记的低利用率:CMLM 主要关注掩码标记,但它不能同时利用其他标记来学习视觉语言关联。

为了处理这些限制,我们提出 EPIC。在 EPIC 中,对于每个图像-句子对,我们掩盖对图像显著的标记(即,基于显著性的掩盖策略),并用从语言模型中采样的备选标记来替换它们(即,不一致标记生成流程),然后模型需要为句子中的每个标记确定它们是否与图像一致(即图像-文本一致性判别任务)。

我们提出的 EPIC 方法很容易与现有的预训练方法相结合。大量实验表明,将 EPIC 方法与最先进的预训练方法(包括 ViLT、ALBEF、METER 和 X-VLM)相结合,可以显着改进下游任务。

图4

该研究工作的第一作者是2022级南方科技大学-香港科技大学联培博士生苟耘豪,导师为张宇老师。张宇老师为通讯作者,南科大为第一单位。

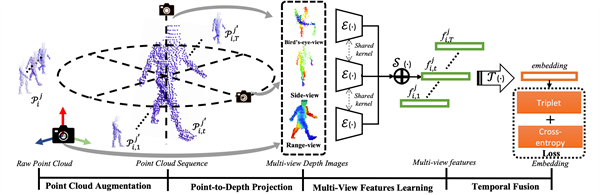

5、LidarGait: Benchmarking 3D Gait Recognition with Point Clouds

Chuanfu Shen, Fan Chao, Wei Wu, Rui Wang, George Q. Huang, Shiqi Yu*

基于视频的步态识别近年来在公开数据集上实现了出色的结果。然而由于视觉相机缺失对于三维信息显性提取,使得步态识别对实际环境中诸如变光,暗光,遮挡,复杂背景的敏感,难以应用于实际场景中。在本文中,我们探索基于点云的3D 步态特征,并提出一个简单而有效的 3D 步态识别框架,称为 LidarGait。为了从点云中学习具有 3D 几何信息,LidarGait 将人体点云从不同的角度投影到多个深度图中,然后将深度图像融合在一起。此外,我们建立了第一个大规模的基于激光雷达的步态识别数据集,SUSTech1K。数据集包含1,050 个行人ID, 25,253个双模态步态序列,涵盖许多不同的变化,包括变光、视角、遮挡、服装、携带物和场景。我们的实验表明:(1) 3D 结构信息是步态识别的重要特征。(2) LidarGait 不仅性能超越其他具有代表性的基于点的方法,而且还大大优于现有的基于相机的方法。(3) 激光雷达传感器在室外环境下的步态识别优于RGB摄像头。

图5

该工作的第一作者是2019级南方科技大学-香港大学联培博士生沈川福,导师为于仕琪。于仕琪老师为通讯作者,香港大学为第一单位。

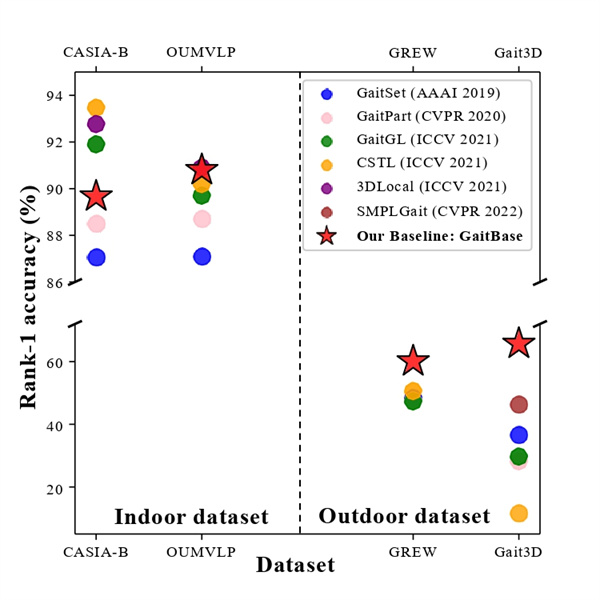

6、OpenGait: Revisiting Gait Recognition Toward Better Practicality

Chao Fan, Junhao Liang, Chuanfu Shen, Saihui Hou, Yongzhen Huang, Shiqi Yu*

步态识别是最具潜力的远距离身份识别技术之一。以往研究在室内场景下实现了重要进展,但证据表明现有方法在户外场景下表现得不如人意。此外,本文还发现许多以往结论在户外场景下也并不可靠。因此,除了提出一个具体模型以实现更好的准确率外,本文更重要的目的在于开展综合性基准研究从而赋予步态识别技术更好的实用性。为此,我们首先开发了一个灵活且高效的步态代码库OpenGait.据此,我们进行了大规模且系统性的剥离实验来深度剖析现有方法,发现了许多可能导致算法在户外场景下失效的潜在因素。同时,这也为未来研究提供了新见解。受以上发现启发,我们开发了一个结构上简单、性能上强悍且实验上鲁棒的基准模型GaitBase.所有审稿人均认为该工作对领域有潜在重要影响力,并一致给出5分(最高分)评价。该论文被CVPR 2023选为精彩论文(highlight)。

图6

该工作的第一作者是于仕琪老师指导的2021级自主培养博士生樊超,通讯作者为于仕琪老师,南科大为第一作者单位。

南方科技大学计算机科学与工程系